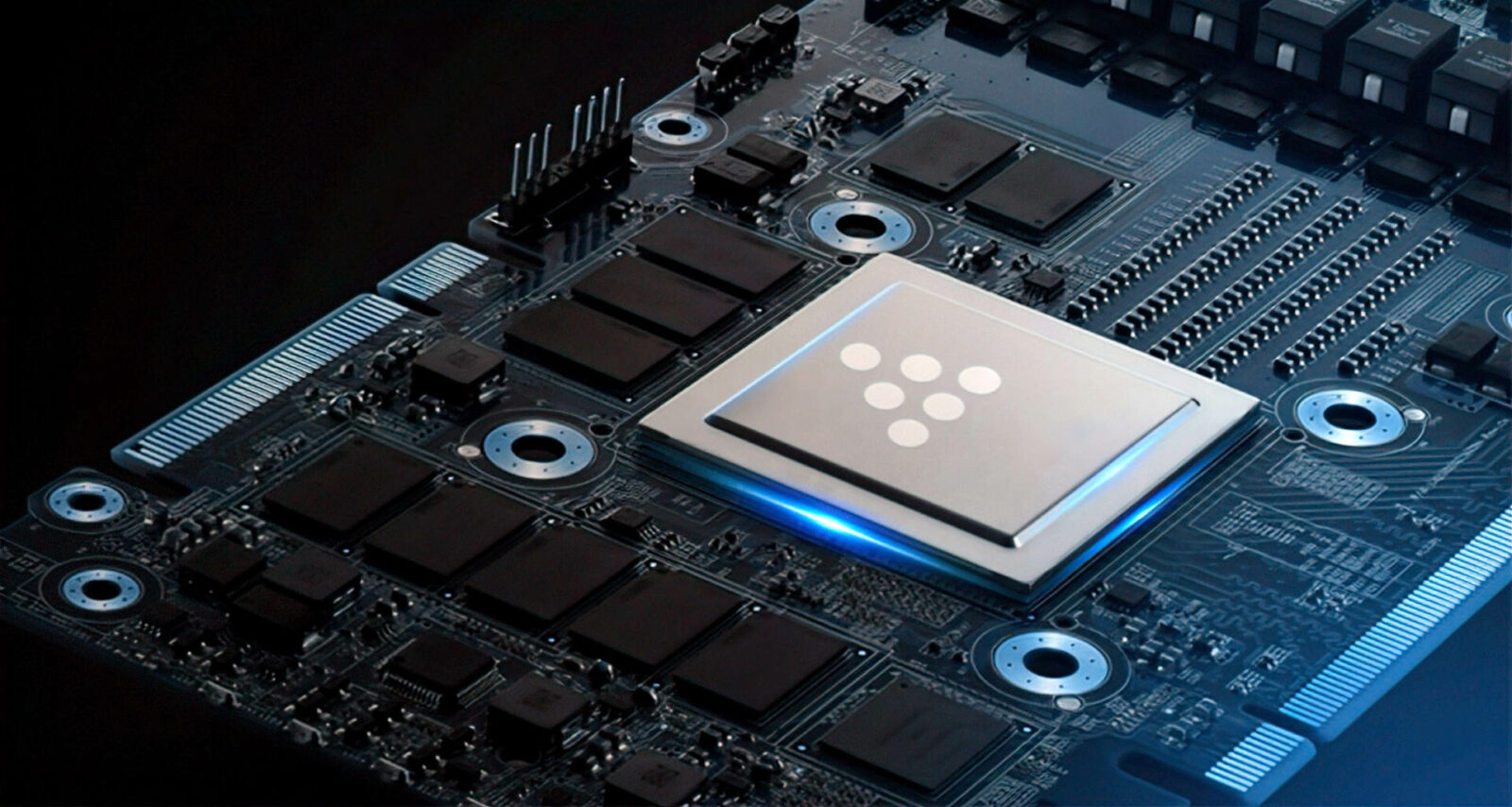

Con il costante progredire dell’intelligenza artificiale, le aziende hanno sempre più bisogno di infrastrutture convenienti e immediatamente disponibili per uno sviluppo e una messa in opera rapidi. Per soddisfare questa domanda, Intel ha lanciato Xeon 6 con Performance-core (P-core) e gli acceleratori AI Gaudi 3, rafforzando l’impegno dell’azienda nel fornire sistemi AI potenti con prestazioni per Watt ottimali e un costo d’esercizio (TCO) più conveniente.

I più recenti progressi di Intel nell’infrastruttura AI includono due importanti aggiornamenti al portfolio di soluzioni per i data center.

-

Intel Xeon 6 con P-core: progettato per gestire con efficienza i carichi di lavoro ad alta intensità di calcolo, Xeon 6 offre il doppio delle prestazioni rispetto al suo predecessore. Presenta un maggiore numero di core, memoria con un’ampiezza di banda doppia e capacità di accelerazione AI integrate in ogni core. Questo processore è progettato per soddisfare le richieste di prestazioni dell’AI dagli ambienti edge ai data center e cloud.

- Acceleratore AI Intel Gaudi 3: specificamente ottimizzato per l’intelligenza artificiale generativa su grande scala, Gaudi 3 vanta 64 core Tensor (TPC) e otto matrix multiplication engine (MME) per accelerare l’elaborazione nelle reti neurali profonde. Include 128 gigabyte (GB) di memoria HBM2e per l’addestramento e l’inferenza, e 24 porte Ethernet da 200 Gigabit (Gb) per reti scalabili. Gaudi 3 offre anche una compatibilità senza soluzione di continuità con il framework PyTorch e modelli avanzati di trasformatore e diffusore Hugging Face. IBM e Intel stanno collaborando per fornire una capacità di servizio Gaudi 3 per gli utenti AI. Grazie a questa collaborazione, le due aziende mirano ad abbassare i costi di possesso (TCO) per utilizzare al meglio e scalare l’AI, migliorando al contempo le prestazioni.

L’implementazione dell’AI su larga scala comporta considerazioni quali opzioni di implementazione flessibili, rapporti prezzo-prestazioni competitivi e tecnologie AI accessibili. La solida infrastruttura x86 di Intel e il grande ecosistema aperto la posizionano per sostenere le aziende nella creazione di sistemi AI di alto valore con un TCO conveniente e prestazioni per Watt ottimali. In particolare, il 73% dei server accelerati da GPU utilizza Intel Xeon come CPU host. Intel collabora con i più importanti OEM, tra cui Dell Technologies e Supermicro, per sviluppare sistemi co-progettati su misura per le esigenze specifiche dei clienti, per implementazioni efficaci dell’intelligenza artificiale. Dell Technologies sta attualmente co-progettando soluzioni basate su RAG (retrieval-augmented generation) utilizzando Gaudei 3 e Xeom 6.

La transizione delle soluzioni di AI generativa (Gen AI) da prototipi a sistemi pronti per la produzione presenta sfide in termini di monitoraggio real-time, gestione degli errori, logging, sicurezza e scalabilità. Intel affronta queste sfide grazie alla co-progettazione con OEM e partner per fornire soluzioni RAG pronte per andare in produzione. Queste soluzioni, basate sulla piattaforma Open Platform Enterprise AI (OPEA), integrano microservizi basati su OPEA in un sistema RAG scalabile, ottimizzato per i sistemi Xeon e Gaudi AI, progettato per consentire ai clienti di integrare facilmente applicazioni da Kubernetes, Red Hat OpenShift.AI e Red Hat Enterprise Linux AI. Il portfolio Tiber di Intel offre soluzioni professionali per affrontare le sfide associate ad accesso, costi, complessità, sicurezza, efficienza e scalabilità negli ambienti AI, cloud ed edge. Intel Tiber Developer Cloud fornisce oggi sistemi di preview di Intel Xeon 6 per valutare e testare la tecnologia. Inoltre, alcuni clienti selezionati otterranno un accesso anticipato a Intel Gaudi 3 per la convalida delle distribuzioni di modelli AI, con cluster Gaudi 3 che inizieranno a essere implementati nel prossimo trimestre per implementazioni su larga scala.

Le nuove offerte di servizi includono SeekrFlow, una piattaforma AI end-to-end di Seekr per lo sviluppo di applicazioni AI affidabili. Gli ultimi aggiornamenti software includono la versione più recente di Synapse e i notebook Jupyter caricati con PyTorch 2.4 e Intel oneAPI e gli strumenti AI 2024.2, che includono nuove capacità di accelerazione AI e supporto per processori Xeon 6.

Clicca sulla copertina per leggere